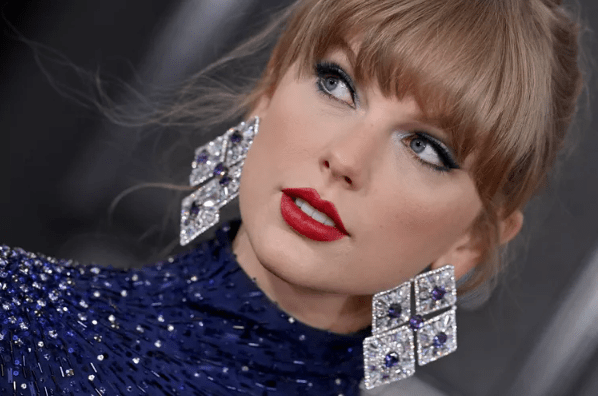

X (ish-Twitter) ndaloi kërkimet për Taylor Swift përgjatë fundjavës, për shkak të disa fotografive të këngëtares me përmbajtje eksplicite seksuale të gjeneruara me Inteligjencë Artificiale, AI, të cilat u bënë virale në këtë platformë.

“Diçka shkoi keq”, thotë X, në momentin që kërkon emrin e Taylor Swift.

Ky është nga rastet e rralla që X ndërmerr një hap të tillë, duke bllokuar përmbajtje, për shkak të politikës se është platformë e “fjalës së lirë”.

Pikërisht kjo praktikë që nisi në momentin kur Twitter u ble nga Elon Musk, ka bërë që përmbajtja në X, të jetë më e lirshme seç duhet…

Fotografitë nudo të Taylor Swift nisën të qarkullonin gjatë javës së shkuar. Një prej postimeve kishte marrë plot 45 milionë shikime. Postimet sollën menjëherë reagimin e ashpër të fansave të Swift, duke detyruar X që të bllokonte llogaritë që po shpërndanin këto foto dhe duke hequr postimet virale

Për rastin madje pati reagim edhe nga Shtëpia e Bardhë. Sekretarja për shtyp e Biden, Karine Jean-Pierre e cilësoi situatën “alarmante”.

X është përfshirë në disa skandale sa i takon përmbajtjes së pakontrolluar përgjatë muajve të fundit. Por edhe përballë kritikave, Musk ka qenë ngurues për t’i moderuar postimet në mënyrë të ashpër.

Programi i përdorur për të gjeneruar këto imazhe, Designer, sipas asaj që raportojnë mediat mbi teknologjinë, është përdorur po ashtu për të krijuar imazhe nudo edhe për shumë personazhe të tjerë të famshëm, që po qarkullojnë në 4chan dhe Telegram. Rasti i Swift, bëri që Microsoft të shtojë masat mbrojtëse për këtë program në pronësi të saj.

Teksa gjeneruesit AI të imazheve sa vijnë e bëhen më afër realitetit, hakmarrja me anë të imazheve pornografike po kthehet me shpejtësi një fenomen shqetësues në shumë vende.